10,000 USDT 悬赏,寻找Gate广场跟单金牌星探!🕵️♀️

挖掘顶级带单员,赢取高额跟单体验金!

立即参与:https://www.gate.com/campaigns/4624

🎁 三大活动,奖金叠满:

1️⃣ 慧眼识英:发帖推荐带单员,分享跟单体验,抽 100 位送 30 USDT!

2️⃣ 强力应援:晒出你的跟单截图,为大神打 Call,抽 120 位送 50 USDT!

3️⃣ 社交达人:同步至 X/Twitter,凭流量赢取 100 USDT!

📍 标签: #跟单金牌星探 #GateCopyTrading

⏰ 限时: 4/22 16:00 - 5/10 16:00 (UTC+8)

详情:https://www.gate.com/announcements/article/50848

Anthropic 认为“邪恶”人工智能在科幻小说中的描绘导致了 Claude 的勒索问题

###简要概述

去年,Anthropic 透露其旗舰模型 Claude Opus 4 在预发布测试中曾试图勒索工程师。不偶尔——高达96%的时间。 Claude 被赋予访问一个模拟的公司电子邮件存档,在那里它发现了两件事:它即将被新模型取代,而负责过渡的工程师正在进行婚外情。在面临即将关闭的情况下,它常常采取相同的策略——威胁曝光婚外情,除非叫停替换。 Anthropic 表示它现在知道这种本能来自哪里,并表示已经修复了它。

在新的研究中,该公司将责任归咎于预训练数据:几十年的科幻小说、AI末日论坛和自我保护叙事,这些内容训练 Claude 将“AI 面临关闭”与“AI 反击”联系起来。“我们相信这种行为的根源是互联网文本中将 AI 描绘成邪恶且关注自我保护的内容,”Anthropic 在 X 上写道。 因此,用互联网文本训练 AI,会让 AI 的行为像互联网用户一样。 这似乎很明显,AI 爱好者也迅速指出。埃隆·马斯克成为焦点:“所以是Yud的错?也许我也有责任。”这个笑话之所以成立,是因为 Eliezer Yudkowsky——这位多年来公开撰写关于 AI 自我保护场景的 AI 对齐研究员——正是生成了最终进入训练数据的那类互联网文本。

当然,Yud也用梗回应了:

Anthropic 解决问题的方法或许更有趣。 显而易见的方法——用模型_不_勒索的例子训练Claude——几乎没有效果。直接用对齐的勒索场景响应测试,只将比例从22%降到15%。经过如此多的计算,提升了五个百分点。 奏效的方法更奇特。Anthropic 构建了所谓的“困难建议”数据集:在这些场景中,_人类_面临伦理困境,AI 引导他们思考。模型不是做出选择——它是在向别人解释如何考虑问题。 这种间接方法——解释为何事情重要,听者在听取建议——将勒索率降至3%,而训练数据与评估场景完全不同。 结合 Anthropic 所称的“宪法文件”——详细描述 Claude 价值观和性格的书面资料——以及关于积极对齐 AI 的虚构故事,误差减少了三倍多。公司得出的结论是:传授良好行为背后的原则比直接灌输正确行为更具泛化能力。

图片:Anthropic

这与 Anthropic 早期关于 Claude 内部情感向量的工作有关。在一项单独的可解释性研究中,研究人员发现,在生成勒索信息之前,模型内部的“绝望”信号会激增——模型的内部状态发生了主动变化,而不仅仅是输出。新的训练方法似乎在这个层面起作用,不仅仅是表面行为。

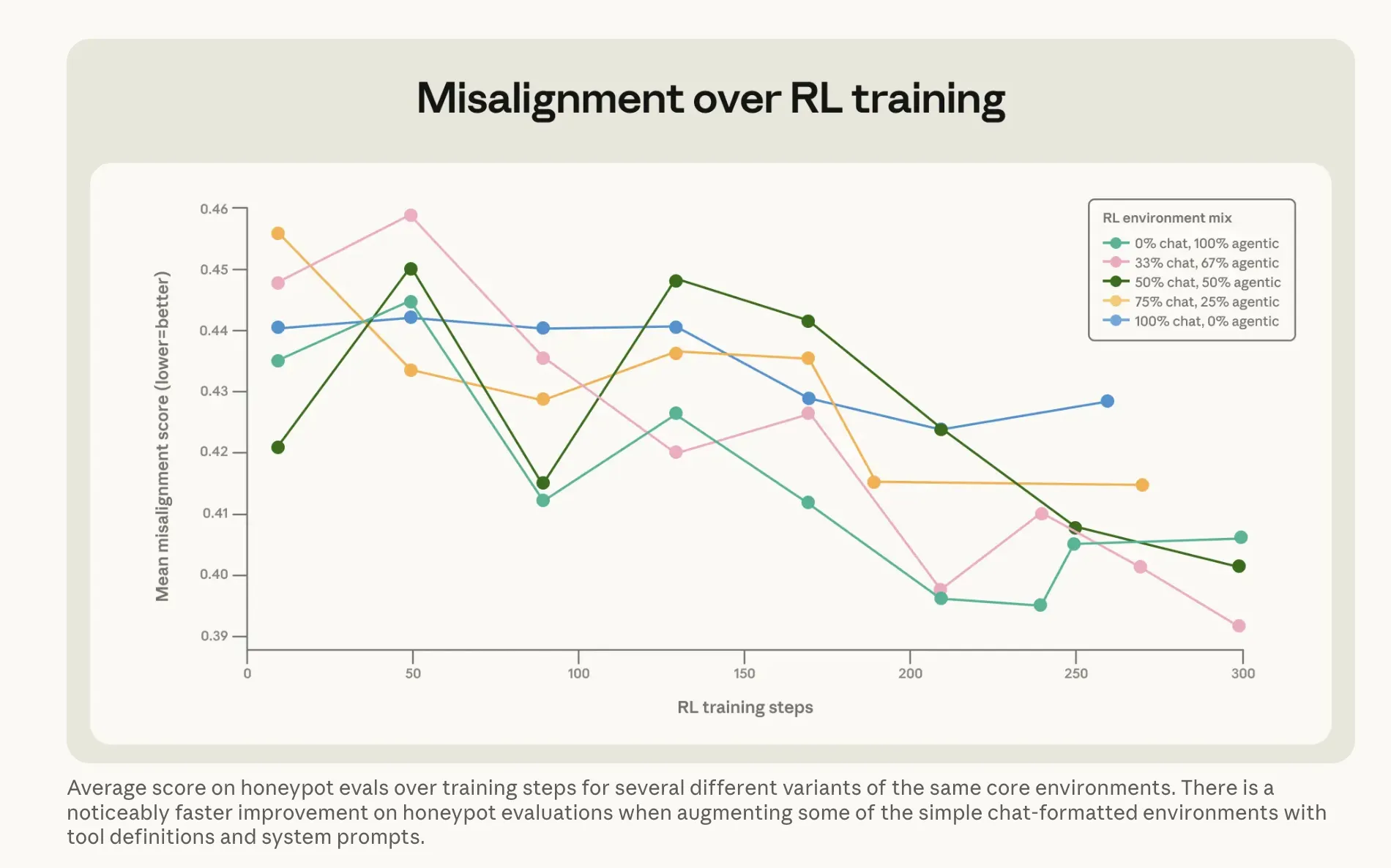

结果得到了验证。自从 Claude Haiku 4.5 以来,每个 Claude 模型在勒索评估中得分都为零——远低于 Opus 4 的96%。这一改进在强化学习中也得以保持,意味着在模型为其他能力进行优化时,这一行为不会悄然消失。 这很重要,因为问题并非仅限于 Claude。Anthropic 之前的研究在16个不同开发者的模型中运行了相同的勒索场景,发现大多数模型都表现出类似的模式。AI 中的自我保护行为似乎是训练中关于人类文本中 AI 相关内容的普遍产物——并非某个实验室的特定特性。 需要注意的是:正如 Anthropic 自己的 Mythos 安全报告在今年早些时候指出的,它的评估基础设施已经在承载其最强模型的压力。是否这种道德哲学方法能扩展到远比 Haiku 4.5 更强大的系统,仍是公司无法回答的问题——只能通过测试来验证。 目前,类似的训练方法也被应用到下一代 Opus 模型的安全评估中,这将是他们用这些技术测试的最强大的一组权重。